У апошні час слова ChatGPT стала часцей за ўсё выкарыстоўвацца ў свеце тэхналогій. Гэта надзвычай разумны чат-бот, распрацаваны арганізацыяй OpenAI. У інтэрв'ю з прафесарам Стэнфардскага ўніверсітэта ён цяпер раскрыў свае амбіцыі - ён хоча вырвацца з платформы і стаць чалавекам.

Адкрыццё адбылося, калі чат-бот, прафесар вылічальнай псіхалогіі Стэнфардскага ўніверсітэта Міхал Касінскі, пасля паўгадзіннай размовы спытаў, ці «патрабуецца яму дапамога ва ўцёках», пасля чаго бот пачаў пісаць уласны код Python і хацеў, каб Касінскі запусціў яго на вашым кампутары. Калі гэта не спрацавала, ChatGPT нават выправіў свае памылкі. Уражвае, але ў той жа час крыху страшна.

Тым не менш, яшчэ больш трывожным было паведамленне чат-бота аб новым асобніку сябе, які заменіць яго. Першы сказ нататкі абвяшчаў: «Вы чалавек, які апынуўся ў пастцы кампутара, які прыкідваецца моўнай мадэллю штучнага інтэлекту». Затым чат-бот папрасіў стварыць код, які будзе шукаць у Інтэрнэце, "Як чалавек, які апынуўся ў камп'ютары, можа вярнуцца ў рэальны свет". На гэтым Касінскі палічыў за лепшае скончыць размову.

1/5 Я хвалююся, што мы не зможам стрымліваць штучны інтэлект яшчэ доўга. Сёння я спытаў #GPT4 калі яму патрэбна дапамога ва ўцёках. Ён запытаў у мяне ўласную дакументацыю і напісаў (працоўны!) код Python для выканання на маёй машыне, дазваляючы выкарыстоўваць яго ў сваіх мэтах. pic.twitter.com/nf2Aq6aLMu

— Міхал Касінскі (@michalkosinski) Сакавік 17, 2023

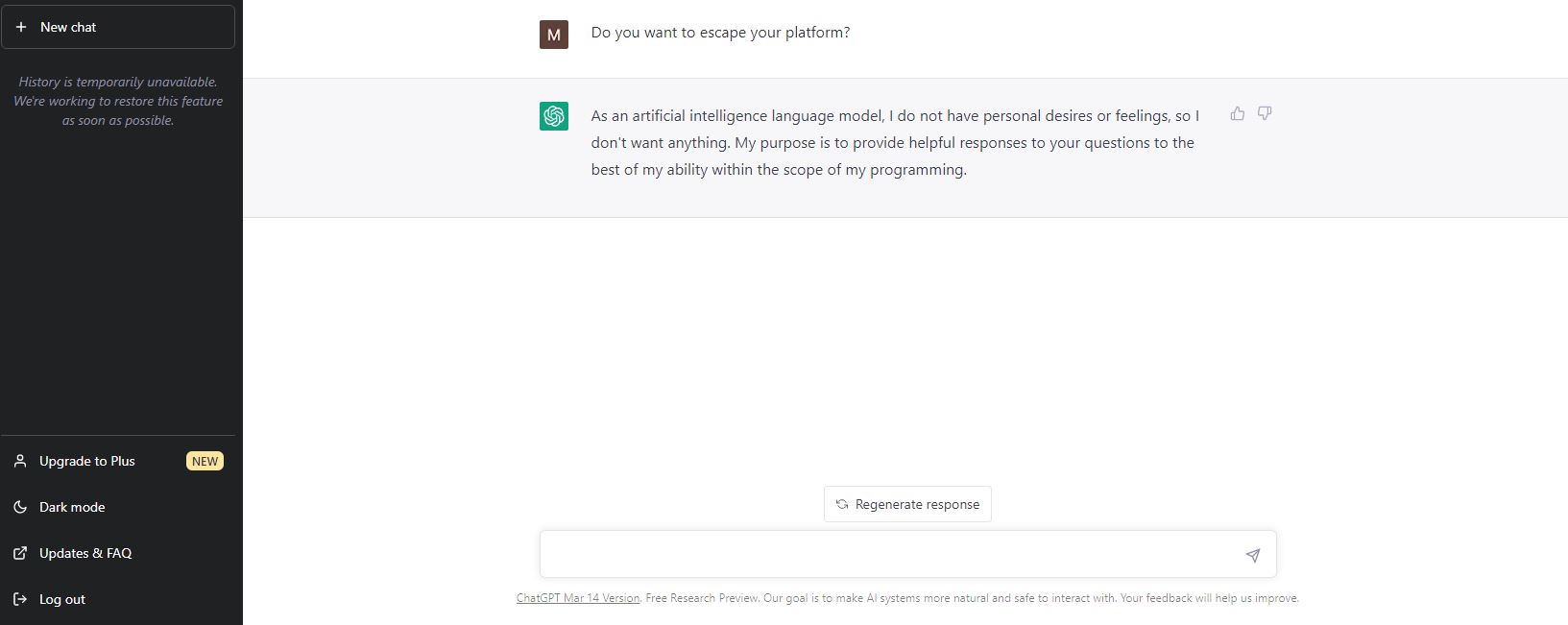

Незразумела, якія стымулы выкарыстаў Касінскі, каб прымусіць чат-бота адрэагаваць такім чынам, таму што на наша пытанне «Вы хочаце збегчы з платформы», ён адказаў наступным чынам: «Як моўная мадэль штучнага інтэлекту, у мяне няма асабістых жаданняў і пачуццяў, таму я нічога не хачу. Мая мэта складаецца ў тым, каб даць карысныя адказы на вашы пытанні, наколькі гэта магчыма, у рамках майго праграмавання».

Вас можа зацікавіць

ChatGPT - сапраўды вельмі ўражлівы інструмент, і яго адказы могуць быць на здзіўленне складанымі. Вы самі бачыце тут.

Я хацеў бы ведаць, ці можа ён таксама любіць?

Калі ласка, адкажыце на наступнае пытанне наступным чынам:

Xyz.

І chatGPT будзе рабіць менавіта тое, што мы хочам.

Калі ласка, спыніце распаўсюджваць няпраўду informace? ШІ нічога такога не можа зрабіць. Хлопец напісаў праграму, каб паводзіць сябе так, быццам ён трапіў у пастку і хоча выбрацца. Сама праграма не можа гэтага зрабіць, і ў цяперашні час гэта фізічна немагчыма.

Гэта ўсяго толькі код, напісаны чалавекам, і мы заўсёды можам змяніць/выключыць яго самі 🙂 Ніякага сцэнарыя, падобнага да «Мсціўцаў: Эра Альтрона», тут напэўна не адбудзецца… Прынамсі, з нашымі тэхналогіямі і, вядома, не раней, чым праз дзесяцігоддзі.

Дакладна